易翻译的准确性与语言对、输入方式(文本/语音/拍照/对话)、句子复杂度和专业术语有关。日常短句和常用表达通常翻译较准,含上下文或行业词汇时误差更大。判断是否“译准”,应结合客观评测(如BLEU/chrF和人工评估)与真实场景测试。下面详细说明如何测试、常见影响因素及提升方法。并给出可操作建议。可验证!

先把问题拆开:什么是“译准”?为什么难说一刀切

要回答“易翻译译准吗”,先得把“译准”这个词拆成两部分来看:忠实度(原意有没有保留)和流利度(译文读起来自然不别扭)。像人类一样判断翻译质量,我们通常会考虑语义保留、语法和风格、以及对行业术语的处理能力。

机器翻译并不是一个固定精度的机器表盘,它像是一个厨师做菜——材料(输入)不同、配方(模型和词表)不同、火候(上下文长度、实时性)也不同,最终味道会有差异。所以不能简单回答“准”或“不准”,而要基于场景和衡量方法来评估。

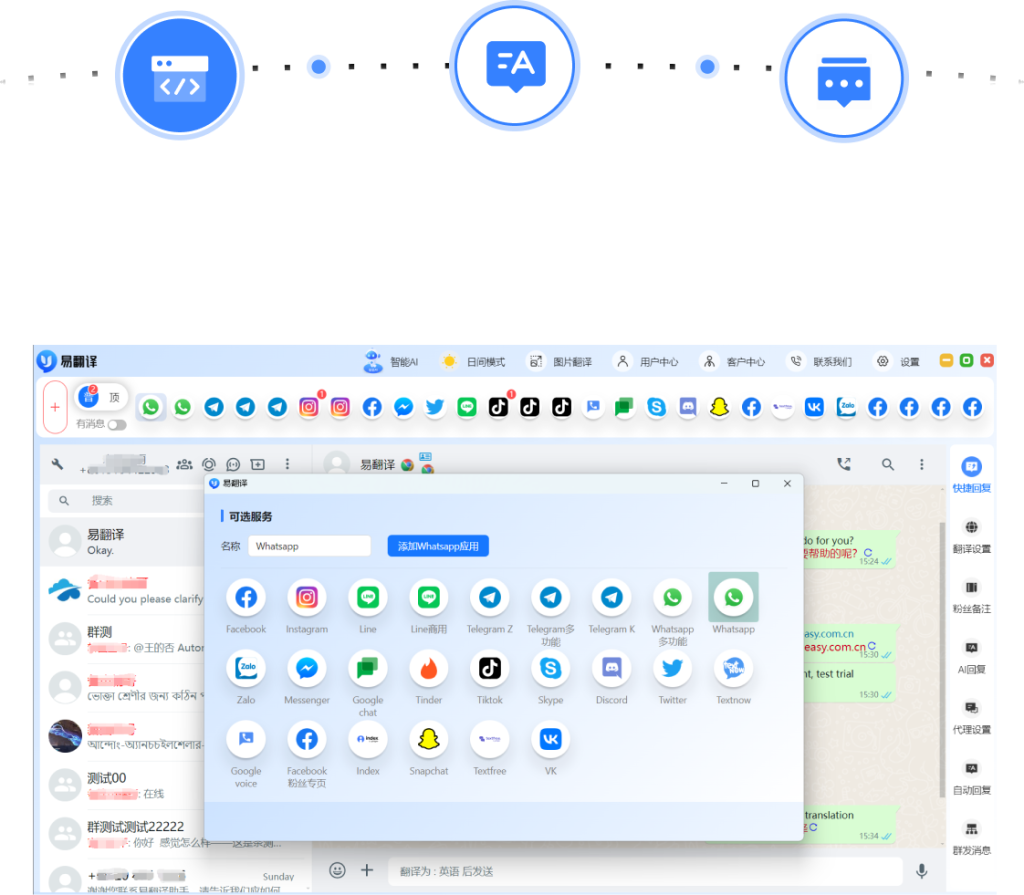

易翻译四大核心功能与准确性影响要点

文本输入翻译(最容易量化)

文本翻译通常表现最稳定,原因是输入是离线文本,且可以通过更完整的上下文进行建模。关键影响因素包括:

- 语言对:中英、中日、中法等高资源对通常更好;小众语言对可能词典缺失。

- 句子长度与复杂度:短句、日常对话类表现好;长句、从句多的学术或法律文档容易出错。

- 专有名词与术语:若无领域词表,容易直译或误译。

语音实时互译(多一层语音识别)

语音翻译 = 语音识别(ASR)+ 机器翻译(MT)+ 语音合成(TTS)。任何一步出错都会影响最终结果。

- 背景噪音、口音、说话速度会影响ASR准确率。

- 断句、语气词的识别与转换对语义连贯性有较大影响。

- 实时传输延迟和流式翻译策略也会改变效果(牺牲一点准确度换速度)。

拍照取词翻译(OCR 决定成败)

拍照翻译的第一步是OCR(光学字符识别),OCR错了,翻译必定错。影响因素包括图片清晰度、字体、排版和语言混排。

双语对话翻译(长上下文与多轮)

对话翻译要求跨句子保持一致性(比如人名、术语的一致翻译),还要实时处理插话、打岔、重复等口语现象。这比单句翻译更考验系统的上下文建模能力。

如何用客观事实来评估“译准”——一个可复现的测试流程

下面给出一个简单、可操作的评测方案,你可以在一小时到几天内完成,得到客观结果。

- 准备数据集:选取若干代表性语料,包括旅游对话(100句)、日常短句(200句)、行业文本如医疗或法律(200句)、新闻长句(100句)。每个句子同时保留人工参考译文。

- 运行翻译:在相同网络与设备条件下,分别用易翻译的文本/语音/拍照/对话功能得到译文或识别文本。

- 自动评分:计算BLEU、chrF等指标(参考:Papineni et al., 2002)。这些指标给你机器与参考译文的相似度量化值。

- 人工评估:至少找3位双语评审做打分(1-5分),评估忠实度与流利度,并记录典型错误类型。

- 分析与对比:把不同场景、不同输入方式的得分汇总,观察在哪些场景下表现好/不好。

示例表格:推荐的测试分布(可复制执行)

| 语料类别 | 句数 | 难点 |

| 旅游/日常对话 | 200 | 口语、省略、俚语 |

| 新闻/正式写作 | 150 | 长句、嵌套从句 |

| 行业术语(医疗/法律) | 200 | 专有名词、术语一致性 |

| 拍照/OCR示例 | 100 | 排版、字体、混合语言 |

| 语音(不同口音) | 100 | 噪音、口音、说话速度 |

怎样解读评测结果:几个可能的结论与含义

- 如果文本BLEU高且人工评分高:说明文本模式可靠,可用于日常沟通和非专业场合。

- 若文本表现好但语音模式打分低:问题多半在ASR端,建议在安静环境或使用耳机麦克风。

- 如果行业文本BLEU低、人工评分差:需要术语表、模型微调或启用人工后编辑。

- 拍照模式低分常伴随OCR错误,改进方法是提高清晰度或手动选择文本区域。

与其它主流翻译产品的比较思路(不做绝对排名)

直接把易翻译与Google Translate、DeepL、百度翻译等比对,是评估时常用的方法,但要注意:

- 不同服务擅长的语言对不同;DeepL在欧语对表现突出,Google在广语言覆盖上有优势。

- 评测要统一语料与版本,避免因模型更新或网络差异导致偏差。

实际使用时的优化建议(让“易翻译”更准的实用技巧)

- 短句优先:把复杂句拆成短句,能明显提高准确率。

- 提供上下文:在可编辑的输入里补充一句背景说明,能帮助模型选择正确词义。

- 术语表:在商务或专业场景,提前准备术语对照,人工粘贴或使用应用的自定义词典功能。

- 校对习惯:把机器翻译当作草稿,关键文档请人工复核。

- 拍照前优化:确保光线充足、字体清晰、对齐拍照,或先裁剪文本区域再识别。

- 语音环境:接入麦克风、降噪环境可提高ASR准确率;说话放慢、完整停顿也有帮助。

常见误区(以及为什么会误判“准”或“不准”)

- 误区:机器翻译一次测试好,就代表全面可靠。事实:模型在同一语境外的泛化能力有限。

- 误区:自动指标(如BLEU)完全等同于“人类感受”。事实:自动指标只能给出粗略相似度,需要结合人工主观打分。

- 误区:语音翻译听起来流利就等于准确。事实:流利的合成/断句并不代表语义没有偏差。

如果你要做快速验收(10分钟内的简易检查)

- 准备10条不同类型的测试句(1旅游、2日常、3新闻、4术语);

- 用文本输入先翻译一遍,看是否有明显错译;再用语音和拍照各测一次;

- 把所有译文和原文并列,自己打1-5分,总结重复出现的错误类型(比如人名、数字格式、时间表达)。

引用与技术背景(便于深入学习)

如果想进一步理解评测方法和指标,可以参考BLEU(Papineni et al., 2002)、chrF指标,以及近年的神经机器翻译(NMT)综述文章。实际工程上,很多产品会结合ASR、MT和后处理模块来减少错译。

说到这里,可能你会想:那我现在就去卸载还是继续用?其实不用急着下结论,按上面的快速验收流程自己测一次,就能得出适合你场景的答案;如果是重要文件或合同,记得请人工校对,机器只是帮你把沟通速度提上来。随手测一测,然后按需调整,总比空口断言靠谱。