想快速接入“易翻译”开发者API,通常先在控制台注册并拿到API Key/Secret,再用HTTPS向相应REST端点发请求或建立WebSocket/RTC流:文本翻译走POST JSON、图片OCR走multipart/form-data上传、语音实时互译走WebSocket或分片上传并合并,所有请求带上时间戳和签名以防重放,支持同步返回与异步回调两种结果模式;注意限流、重试和音频编码细节就能稳定上线。

先把核心概念讲清楚(像在给朋友解释)

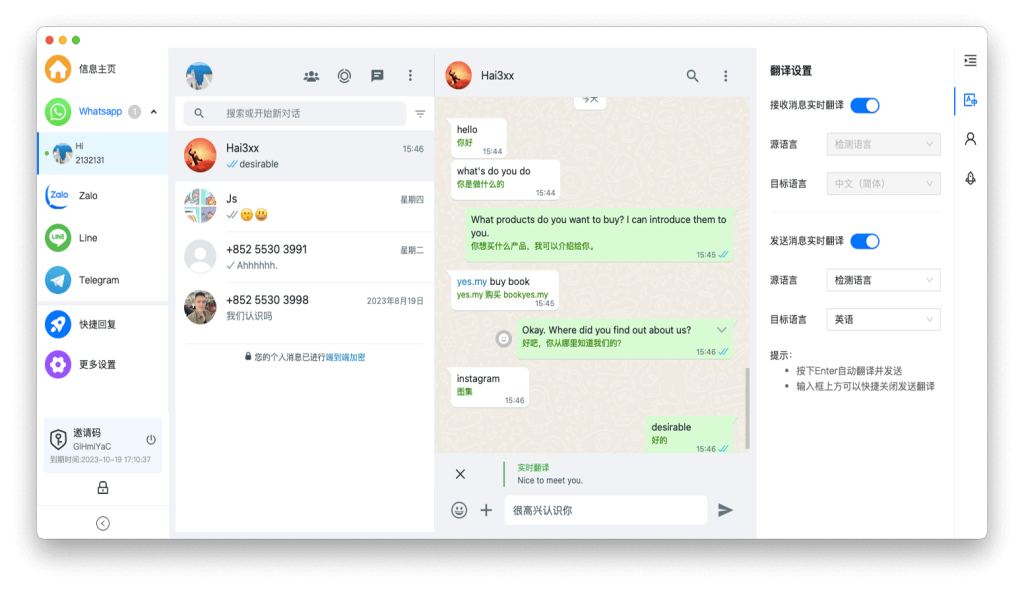

当你第一次听到“调用翻译API”可能会觉得复杂,但本质上就是把要翻译的内容(文本、图片、音频)通过网络发到易翻译的服务器,然后把返回的译文接回来显示或者继续处理。像支付、天气接口一样,有鉴权、请求格式、速率限制和错误码。分清三类场景后会简单很多:

- 文本翻译(最简单):发送原文和源语言/目标语言参数,得到返回的译文。

- 图片OCR + 翻译:上传图片,服务先识别文字再翻译,返回识别+翻译结果。

- 语音/实时对话:可以异步上传音频文件,也可以用WebSocket/RTC实时流式传输,得到逐句识别和翻译。

准备工作:注册、鉴权和开发环境

实际开始前,你需要三步准备:

- 注册开发者账号:在易翻译开发者控制台创建项目并开通API访问,记下API Key与Secret。

- 选择鉴权方式:常见有API Key+签名(HMAC-SHA256)或OAuth2(Client Credentials)。官方一般会把两者都支持,但生产环境常用带签名的Key/Secret来防重放和伪造。

- 准备测试数据与环境:先在本地或测试环境用小样本测试,注意使用HTTPS,避免明文传输Key。

示例:签名鉴权思路(简化版)

为防止请求被伪造,通常用下面步骤生成签名:

- 构造请求参数字符串(如 method + path + timestamp + nonce + bodyHash)。

- 使用 Secret 对该字符串做 HMAC-SHA256,得到 signature。

- 在请求头中带上 API-Key、Timestamp、Nonce、Signature。

这样服务端能通过同样方式验证签名,确认请求来自你,并防止重放攻击。

API端点一览(表格)

| 功能 | HTTP 方法 | 示例端点 | 主要参数 |

| 文本翻译 | POST | /v1/translate/text | source_lang, target_lang, text |

| 图片OCR + 翻译 | POST (multipart) | /v1/translate/image | file, source_lang, target_lang |

| 语音文件翻译(异步) | POST | /v1/translate/audio | file_url 或 multipart, audio_format, sample_rate |

| 实时语音互译(WebSocket) | WebSocket | /v1/ws/translate | API-Key, signature, audio chunks |

| 双语对话管理 | POST / GET | /v1/dialog/session | session_id, speaker, text/audio |

详细调用步骤(一步步来)

1. 文本翻译(同步)

最直观的就是把文本通过JSON发过去,服务立即返回译文。要点在于字符编码(UTF-8)、长度限制和速率。

POST https://api.yifanyi.example.com/v1/translate/text

Headers:

Content-Type: application/json

X-API-Key: your_api_key

X-Timestamp: 2026-04-10T12:00:00Z

X-Signature: hmac-signature

Body:

{

"source_lang": "zh",

"target_lang": "en",

"text": "今天天气不错,我想去散步。"

}

返回示例(简化):

{

"code": 0,

"request_id": "abcdef12345",

"result": {

"translated_text": "The weather is nice today, I want to take a walk."

}

}

2. 图片OCR并翻译

图片通常用multipart/form-data上传,或先上传到对象存储(OSS),再把URL传给API。务必关注图片尺寸、文件大小和识别语言的准确度。

POST https://api.yifanyi.example.com/v1/translate/image

Content-Type: multipart/form-data

Fields:

file: (binary image)

source_lang: auto

target_lang: en

返回含识别段落和相应翻译,其中会给出坐标、置信度等信息,便于前端定位和高亮。

3. 语音文件(异步)

长音频或批量翻译时通常走异步流程:上传文件 -> 服务端返回 jobId -> 等待任务完成(轮询或回调)。上传可以直接用 multipart,也可以先把文件上传到你的云存储再提交URL。

POST /v1/translate/audio

Body:

{

"file_url": "https://your-bucket.example.com/audio1.wav",

"audio_format": "wav",

"sample_rate": 16000,

"source_lang": "auto",

"target_lang": "en",

"callback_url": "https://your.app/callback"

}

回调会带上 jobId、状态、错误码和结果URL,注意验证回调签名以确认来源。

4. 实时语音互译(WebSocket / RTC)

这是稍微复杂但也最实用的场景:低延迟的逐句翻译通常通过WebSocket推送音频流并接收识别与翻译结果。要点:

- 使用小音频帧(例如20-40ms)分片发送,确保音频编码(PCM16/16kHz)一致。

- 先完成鉴权(可通过HTTP签名拿到临时token,或在WebSocket握手时带签名头)。

- 服务端会返回中间识别结果(partial)和最终结果(final),客户端根据场景决定显示方式。

WebSocket wss://api.yifanyi.example.com/v1/ws/translate?api_key=...×tamp=...&signature=...

Client -> Server (binary): audio chunk (PCM16LE)

Server -> Client (text/json): {

"type": "partial",

"speech_id": "s1",

"text": "Hello, my name..."

}

Server -> Client: {

"type": "final",

"speech_id": "s1",

"source_text": "Hello, my name is Li.",

"translated_text": "你好,我叫李。"

}

代码示例(常见语言)

cURL(文本翻译)

curl -X POST "https://api.yifanyi.example.com/v1/translate/text" \

-H "Content-Type: application/json" \

-H "X-API-Key: your_api_key" \

-H "X-Timestamp: 2026-04-10T12:00:00Z" \

-H "X-Signature: your_signature" \

-d '{"source_lang":"zh","target_lang":"en","text":"你好"}'

Python requests

import time, hmac, hashlib, requests, json

api_key = "your_api_key"

secret = b"your_secret"

ts = str(int(time.time()))

payload = "POST/v1/translate/text" + ts

signature = hmac.new(secret, payload.encode('utf-8'), hashlib.sha256).hexdigest()

headers = {

"Content-Type": "application/json",

"X-API-Key": api_key,

"X-Timestamp": ts,

"X-Signature": signature

}

body = {"source_lang":"zh","target_lang":"en","text":"今天天气真好"}

r = requests.post("https://api.yifanyi.example.com/v1/translate/text", headers=headers, json=body)

print(r.json())

Node.js(WebSocket 流式示例,伪代码)

const WebSocket = require('ws');

const ws = new WebSocket('wss://api.yifanyi.example.com/v1/ws/translate?api_key=...&ts=...&sig=...');

ws.on('open', () => {

// 每次发送音频分片

ws.send(audioChunk);

});

ws.on('message', (msg) => {

const obj = JSON.parse(msg);

if (obj.type === 'final') console.log('译文:', obj.translated_text);

});

错误处理、限流与重试策略

任何网络服务都会有失败,实务中你需要考虑以下点:

- HTTP状态与自定义错误码:4xx常是请求问题(参数、鉴权),5xx是服务问题;有时响应体会包含错误码和message。

- 重试策略:对幂等请求可用指数退避(0.5s、1s、2s…),对非幂等请求(比如文件上传)要小心重复提交。

- 限流:关注响应头中的剩余配额(X-RateLimit-Remaining)或在文档里查qps/并发限制,超限会返回限流错误,采用排队或降级方案。

- 超时与断连重连:WebSocket需实现断连重连、未发送分片缓存与序号校验;HTTP请求要设置合理的超时。

安全与合规要点

- HTTPS 必须:所有请求都使用TLS,避免Key泄露。

- 签名与短期Token:避免把长期Secret嵌入客户端,使用后端签发短期token或代理转发。

- 回调验证:异步回调要验证回调签名,并对返回内容做基本校验。

- 隐私保护:敏感文本(个人隐私、身份证号等)要按合规要求处理,必要时在本地脱敏后再上传。

性能优化与成本控制

- 合并小请求:频繁的小文本请求可以合并成批量翻译,减少HTTP开销与费用。

- 缓存常见翻译:对固定词汇或短句做本地缓存,降低调用次数。

- 控制音频质量:实时场景用16k采样、单声道足够;更高采样会增加流量与延迟。

- 异步与回调:长任务用异步方式,避免客户端长时间等待。

调试技巧(那些容易忘的点)

- 检查时区和时间戳:签名鉴权常因时间不同步导致失败,确保服务器时间与UTC对齐。

- 观察request_id:每次请求若返回request_id,保存下来方便和客服或日志对齐。

- 抓包时注意HTTPS:用可信任的方式抓HTTPS链路(例如通过开发者代理或后台日志),不要在生产环境关闭TLS安全。

- 分段上传时保持序号:服务端往往需要收到分片序号,最终合成时按序拼接,缺片会失败。

典型场景实施流程举例(端到端思路)

场景A:旅游App的离线翻译快捷入口

- 用户选定源语/目标语并输入或拍照。

- 客户端对短文本先查本地缓存,未命中时调用文本翻译API。

- 图片则先进行本地预处理(裁剪、压缩),再上传到API进行OCR+翻译。

- 结果展示并保存到本地缓存,便于离线再次使用。

场景B:多语言远程会议的实时字幕

- 使用WebRTC把音频流送到后端中转(或直接用WebSocket)进行实时识别与翻译。

- 后端返回逐句识别文本与对应翻译,客户端显示同步字幕并可切换目标语言。

- 实现细节要处理网络抖动、低延迟和拼接短句。

常见问题FAQ(懒人问答)

- 问:可以批量翻译多句吗?

答:可以,很多端点支持数组形式的文本批量提交,按单次计费或按字符计费视平台规则。 - 问:实时翻译有没有显著延迟?

答:通常实时WebSocket方案延迟在几百毫秒到数秒,取决于音频分片大小、网络和模型处理时间。 - 问:如何提升识别准确率?

答:针对语音,提升采样率、降噪、上下文提示和自定义词表都能显著提高效果。

文档、SDK与支持

一般平台会提供REST文档、WebSocket协议说明和若干官方SDK(Java/JS/Python/Go)。建议先看官方API Reference,跟着示例把简单的文本翻译打通,再扩展到语音与图片模块。遇到问题,记录request_id、时间戳和错误日志再联系技术支持,定位会快很多。

行了,就先写到这儿——接入时你会发现很多细节(比如音频帧格式、并发连接上限之类),但按上面思路一步步来,先把鉴权、一个文本接口跑通,然后逐渐接入图片和实时语音,实战中慢慢调参会更有效。祝接入顺利,偶尔踩坑也别气馁,最后这些都变成经验了。